DeepSeek lance une première version ouverte de DeepSeek-V4, capable de traiter jusqu’à 1 million de tokens de contexte. Cette nouvelle génération se décline en deux variantes, Pro et Flash, avec un objectif clair : offrir de solides performances de raisonnement et des coûts API plus compétitifs. Les deux modèles sont déjà accessibles sur le site de DeepSeek, avec une API mise à jour.

DeepSeek-V4 mise sur un contexte très long pour traiter davantage d’informations

DeepSeek-V4 arrive avec une caractéristique majeure : la prise en charge d’un contexte pouvant atteindre 1 million de tokens. Cette capacité concerne les deux versions annoncées, DeepSeek-V4 Pro et DeepSeek-V4 Flash.

Les modèles sont proposés sur le site de DeepSeek dans deux modes d’utilisation, Instant Mode et Expert Mode. L’entreprise indique aussi que son API a été mise à jour, ce qui permet aux développeurs de commencer à intégrer cette nouvelle génération dans leurs services.

DeepSeek présente cette version préliminaire comme une solution open source à la fois performante et plus économique, notamment pour les usages qui nécessitent de longs documents, de grandes bases de connaissances ou des tâches complexes en plusieurs étapes.

DeepSeek-V4 Pro concentre la puissance avec 1,6 billion de paramètres

DeepSeek-V4 Pro est la version la plus avancée de la série. Elle compte 1,6 billion de paramètres au total, dont 49 milliards de paramètres actifs.

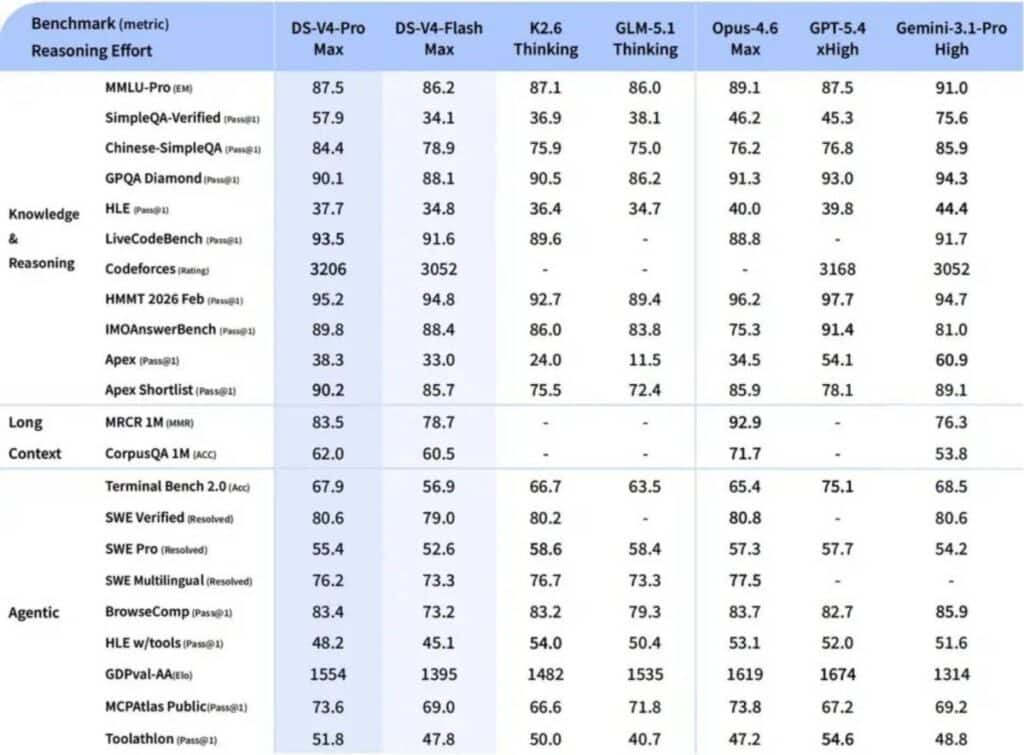

D’après DeepSeek, cette variante améliore les capacités agentiques, c’est-à-dire l’aptitude du modèle à exécuter des tâches plus autonomes et structurées. L’entreprise affirme aussi que Pro dispose d’une connaissance du monde supérieure à celle des autres modèles ouverts existants, tout en restant derrière Gemini 3.1 Pro.

Le modèle est également mis en avant pour le raisonnement. DeepSeek assure que V4 Pro devance les modèles ouverts concurrents en mathématiques, en STEM et en programmation, tout en rivalisant avec les meilleurs modèles fermés.

DeepSeek-V4 Flash vise le même contexte avec des coûts plus bas

DeepSeek-V4 Flash conserve le contexte maximal de 1 million de tokens, mais dans une version plus légère. Elle embarque 284 milliards de paramètres au total, dont 13 milliards actifs.

Cette variante est présentée comme une option plus abordable pour les usages à grande échelle. Selon DeepSeek, Flash offre des capacités de raisonnement proches de Pro et des performances comparables dans les tâches agentiques simples.

La différence se joue donc surtout sur le compromis entre coût et puissance. Flash cible les applications où le volume de requêtes, la rapidité et le prix comptent autant que la qualité des réponses.

Les prix API creusent l’écart entre Flash et Pro

DeepSeek détaille des tarifs API nettement différents selon la version choisie. Pour DeepSeek-V4 Flash, l’entrée est facturée 0,028 dollar en cas de cache hit et 0,14 dollar en cas de cache miss. La sortie coûte 0,28 dollar.

La version DeepSeek-V4 Pro se situe à un niveau bien plus élevé. L’entrée revient à 0,145 dollar avec cache hit et à 1,74 dollar avec cache miss. La sortie est facturée 3,48 dollars.

Cet écart confirme le positionnement des deux modèles. Flash s’adresse aux usages plus économiques, tandis que Pro vise les scénarios qui exigent davantage de puissance, de raisonnement et de capacités agentiques.

Les modèles peuvent déjà être testés en ligne

DeepSeek indique que DeepSeek-V4 est accessible dès maintenant via son service de chat. Les poids ouverts des modèles sont également disponibles, ainsi qu’un rapport technique pour examiner plus précisément leur fonctionnement.

Avec DeepSeek-V4, l’entreprise cherche à renforcer sa place dans la course aux modèles ouverts hautes performances. Le contexte d’un million de tokens, la séparation claire entre Pro et Flash, et les tarifs API très différenciés donnent à cette nouvelle génération un positionnement offensif face aux modèles propriétaires.

Passionné de téléphones mobiles, de maison intelligente et d’intelligence artificielle. Pendant mon temps libre, j’aime nager, faire du vélo et programmer de nouvelles applications.