Google Lens franchit une nouvelle étape grâce à Gemini, en fusionnant les capacités de la caméra et de la reconnaissance vocale.

Jusqu’à présent, l’utilisation classique de Google Lens se déroulait ainsi : l’utilisateur ouvrait l’application et lançait une recherche par image. Il pouvait ensuite ajouter des informations complémentaires. Grâce à la nouvelle fonction vocale intégrée à l’application Lens sur Android, ce processus devient plus fluide et efficace.

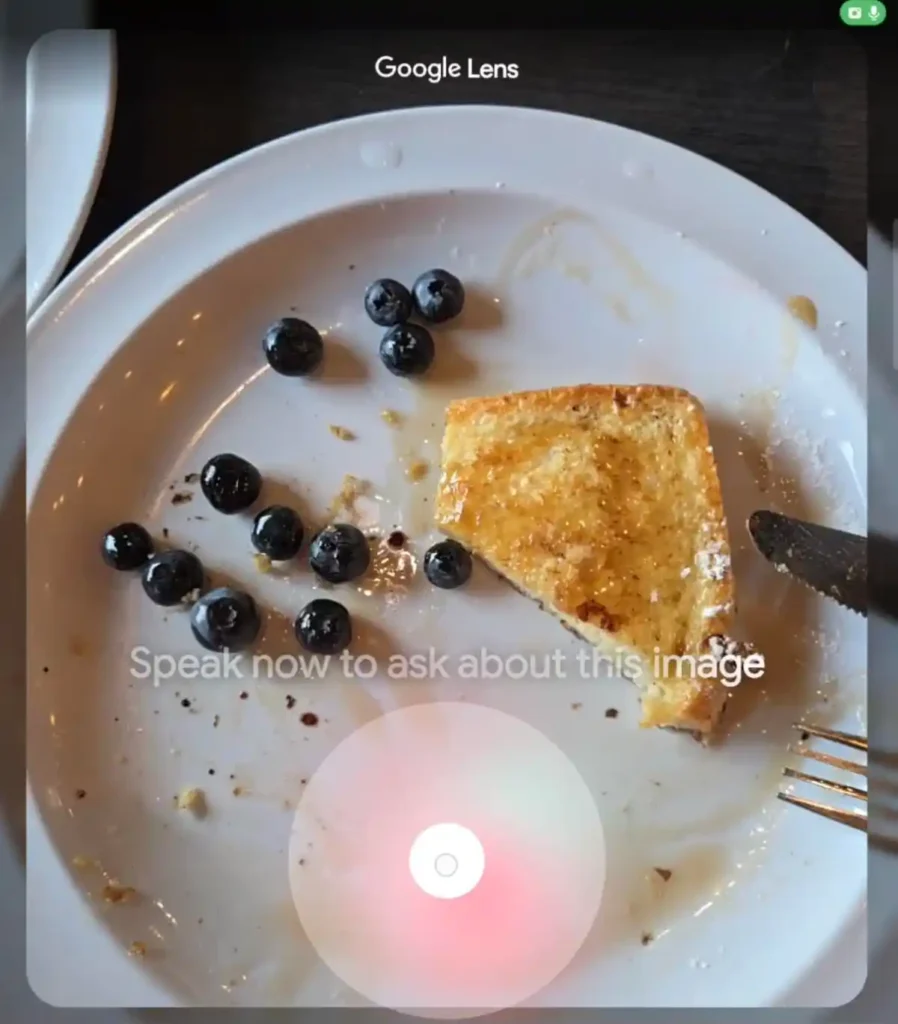

Cette innovation permet d’envoyer simultanément une image et une question posée oralement à Google Lens ou à l’intelligence artificielle. Pour cela, il suffit de maintenir le doigt sur le déclencheur et de formuler la question liée à la photo.

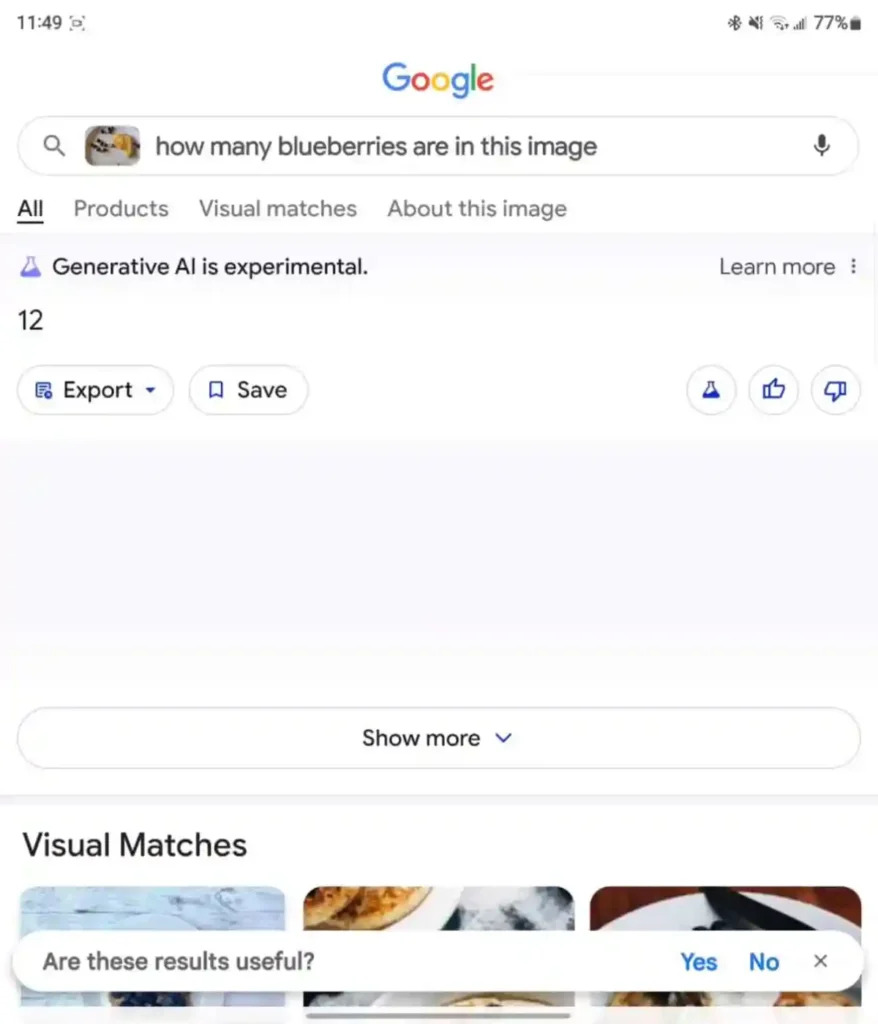

Par exemple, un utilisateur pourrait demander à Google Lens de compter le nombre de myrtilles visibles sur une image. Bien que simple, cet exemple illustre bien le potentiel de la fonction. On pourrait également imaginer une requête pour obtenir une recette à faible teneur en glucides basée sur les aliments présents dans l’assiette photographiée.

Il est important de noter que c’est Gemini, l’IA de Google, qui traitera ces requêtes. Cette fonctionnalité représente une amélioration significative de Google Lens, actuellement en phase de déploiement auprès d’un nombre limité d’utilisateurs Android. La technologie est encore au stade expérimental et en constante évolution.

Je m’appelle Samuel Le Goff. À 38 ans, je suis l’actualité du numérique depuis plus de 14 ans. Aujourd’hui, je m’intéresse particulièrement aux smartphones et aux usages concrets de l’intelligence artificielle, que je traite à travers des contenus clairs et accessibles sur Menow.fr.